llms.txt fajl – Kako da usmerite AI botove ka određenom sadržaju na vašem web sajtu

Ako ste u poslednje vreme primetili neobične posete na svom sajtu koje dolaze od alata poput OpenAI ili Google crawlera, verovatno ste se zapitali da li neko koristi vaš sadržaj bez dozvole. Ili ste možda jednostavno zabrinuti da veliki broj takvih zahteva usporava vaš sajt i kvari korisničko iskustvo vašim posetiocima.

Činjenica je da na današnjem internetu postoji veliki broj AI botova koji neprekidno pretražuju sadržaje po sajtovima u potrazi za sadržajem. To je nešto što je realnost i treba to tako i prihvatiti.

Međutim, AI roboti ne moraju automatski da znače i neki problem. Postoji i dobar način na koji možete da ih iskoristite. Umesto da AI alati nasumično prolaze kroz vaše stranice, skenirajući sve na šta naiđu, možete da ih navedete na lokacije gde se nalazi vaš najvredniji sadržaj i usmeriti ih da koriste upravo te stranice.

Upravo u tome vam pomaže novi format fajla koji se zove llms.txt. Skraćenica ovog fajla potiče od engleske kovanice Large Language Model Search, a njegova svrha je da pomogne velikim jezičkim modelima (LLM-ovima), poput ChatGPT ili Claude, da bolje razumeju vaš sajt i da se lakše usmere ka sadržaju koji želite da istaknete.

Na taj način možete da utičete na to kako će se vaš sajt prikazivati u AI-generisanim odgovorima i na taj način povećate šansu da vaš sajt bude naveden kao izvor.

U ovom tekstu ćemo objasniti kako da prepoznate AI botove koji posećuju vaš sajt, kako da ih usmerite ka svojim ključnim stranicama pomoću llms.txt fajla i kako da po potrebi blokirate određene alate kroz robots.txt.

Kako detektovati AI robote

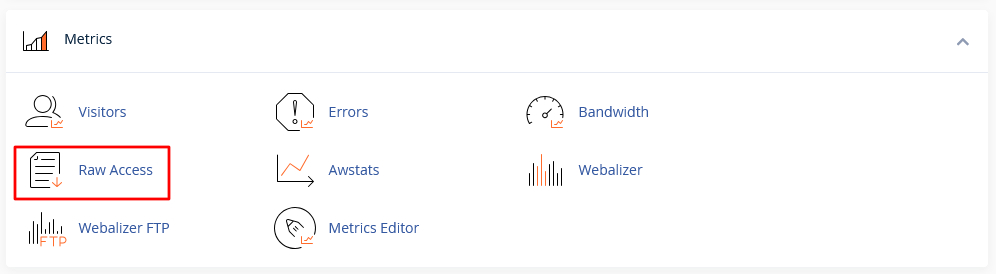

Najpouzdaniji način da otkrijete ko zapravo posećuje vaš sajt jeste da pogledate server logove (najčešće access log), koje možete pronaći u cPanel-u ili preko CDN servisa poput Cloudflare-a.

U cPanel-u, access logove možete najlakše da pronađete tako što u glavnom meniju odaberete sekciju Metrics → Raw Access, a zatim preuzmete log fajl za željeni domen.

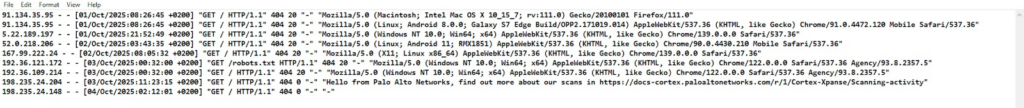

Nakon što preuzmete i otvorite log fajl, u njemu ćete videti detaljne zapise svih poseta sajtu, uključujući IP adrese, user agente, vreme pristupa i URL-ove koji su posećeni.

Svaki crawler (uključujući AI botove) ostavlja trag IP adrese i user agent stringa, što vam omogućava da precizno identifikujete posete koje dolaze od AI alata.

Na primer, u access logu možete videti ovakav zapis:

66.249.66.1 – – [05/Oct/2025:13:24:17 +0200] “GET /blog/seo-vodic/ HTTP/1.1” 200 5320 “-” “GPTBot (compatible; OpenAI)”

U ovom izmišljenom primeru jasno se vidi da je stranicu /blog/seo-vodic/ posetio GPTBot, zvanični crawler kompanije OpenAI.

Pored GPTBot-a, često se pojavljuju i sledeći user agenti:

- ClaudeBot → Anthropic AI

- CCBot → Common Crawl

- PerplexityBot → Perplexity.ai

Pomoću ovih informacija možete precizno videti koje stranice AI botovi posećuju, koliko često, i po potrebi ih blokirati po IP adresi ili user agentu.

Ako koristite Cloudflare, u nastavku ćemo kratko objasniti gde da pronađete ove logove.

Detekcija i kontrola AI botova pomoću Cloudflare AI Crawl Control funkcije

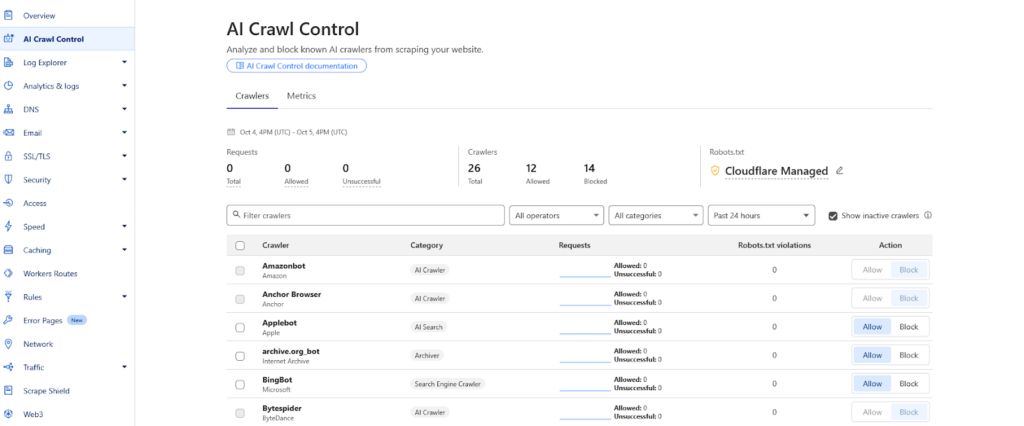

Cloudflare je nedavno uveo novu funkcionalnost pod nazivom AI Crawl Control, koja omogućava da na jednom mestu pregledate poznate AI crawlere koji posećuju vaš sajt i da jednostavno odlučite koje ćete dozvoliti, a koje blokirati. Ova opcija je dostupna i korisnicima besplatnog (Free) naloga, što je čini posebno praktičnom za vlasnike manjih sajtova.

Da biste joj pristupili, u Cloudflare meniju sa leve strane izaberite AI Crawl Control. Na vrhu stranice nalazi se pregled statistike za izabrani vremenski period: ukupan broj AI zahteva, koliko ih je dozvoljeno, koliko blokirano i da li je bilo kršenja vašeg robots.txt fajla.

Ispod se nalazi lista svih prepoznatih crawlera, podeljenih po kategorijama. Među njima su i najpoznatiji AI alati, kao što su GPTBot (OpenAI), ClaudeBot (Anthropic), PerplexityBot, CCBot (Common Crawl), Applebot, Amazonbot i drugi.

Pored svakog bota jasno je naznačeno koliko je zahteva poslao i da li ih je Cloudflare dozvolio ili blokirao. Klikom na Allow ili Block možete ručno da podesite kako će se pojedinačni botovi ponašati ubuduće, bez potrebe za dodatnim konfiguracijama u robots.txt fajlu.

Nažalost, u besplatnom planu ova funkcija ne prikazuje detaljne informacije poput konkretnih stranica koje je bot posećivao ili IP adresa, ali za osnovnu detekciju je više nego dovoljna.

U praksi, ako se na ovoj listi pojavi GPTBot ili ClaudeBot, odmah ćete znati da su AI crawleri bili aktivni, a jednim klikom možete da ih blokirate ili dozvolite njihov pristup.

Ova funkcija je odličan dodatak klasičnim server logovima i robots.txt pravilima, dok logovi pružaju najdetaljniji uvid, AI Crawl Control daje vam brzi, pregledan način da upravljate poznatim AI botovima direktno iz Cloudflare panela.

Sada kada smo videli gde možete da pronažete stranice koje posećuju AI botovi i kako da upravljate njima, vreme je da vidimo i kako da ih usmerite na neki važan sadržaj na svom web sajtu.

Naravno, pre toga da vidimo šta je to llms.txt fajl i čemu on služi.

Šta je llms.txt fajl i zašto vam je potreban

Zamislite llms.txt kao neku vrstu vodiča za AI robote. Umesto da oni sami lutaju po vašem sajtu u pokušaju da pronađu kvalitetan sadržaj, vi im ostavljate jasno obeleženu mapu. U toj mapi su linkovi ka vašim najboljim tekstovima, tutorijalima i ključnim stranicama, onima za koje želite da AI alati najpre znaju.

Tehnički gledano, llms.txt je običan tekstualni fajl koji se postavlja u korenski (root) direktorijum sajta, najčešće na adresi kao na primer: mojdomen.co.rs/llms.txt.

Piše se u jednostavnom Markdown formatu i u njemu se mogu nalaziti linkovi ka sitemap-u, nekim bitnim tekstovima, važnim landing stranicama ili bilo kom drugom sadržaju koji želite da bude istaknut.

U svetu SEO-a pojavio se i termin za ovakav pristup: Generative Engine Optimization (GEO). Ideja je da, baš kao što klasični SEO utiče na to kako se vaš sajt prikazuje u rezultatima pretrage, GEO utiče na to kako se vaš sadržaj pojavljuje u odgovorima koje generišu AI alati.

U jednom od naših ranijih tekstova na blogu smo već pisali na temu GEO, pa preporučujemo da pročitate Šta je GEO i kakve to veze ima sa vašim web sajtom?

Važno je naglasiti da je llms.txt još uvek nova stvar i da je podrška različitih kompanija ograničena. Ipak, to ne umanjuje njegov značaj. Ako već sada počnete da ga koristite, imate priliku da zauzmete bolju poziciju u AI pretragama kada ovaj standard postane šire prihvaćen.

Ukoliko niste sigurni kako se kreira XML sitemap, pripremili smo vam vodič pod nazivom Kako da ručno kreirate XML sitemap.

llms.txt i robots.txt — ključna razlika

Na prvi pogled, llms.txt može da podseti na robots.txt, jer se oba fajla nalaze u korenu (root-u) sajta i bave se komunikacijom sa botovima. Ipak, njihova svrha je potpuno različita.

Robots.txt služi da kažete crawlerima šta smeju, a šta ne smeju da indeksiraju. Na primer, možete blokirati određene foldere, admin sekcije ili privatne stranice tako da ih Google i drugi pretraživači ne obrađuju.

Ukoliko želite da saznate više o Robots.txt fajlu, predlažemo da pročitate Šta je robots.txt fajl i kako da ga podesite na svom web sajtu?

llms.txt, s druge strane ne blokira ništa. On ne zabranjuje, već preporučuje. Kroz llms.txt vi dajete listu linkova koje želite da AI alati prvo uzmu u obzir kada generišu odgovore.

Zbog toga se robots.txt i llms.txt ne isključuju međusobno. Naprotiv, najbolje je da ih koristite zajedno: robots.txt za zaštitu i kontrolu pristupa, a llms.txt za usmeravanje i isticanje sadržaja koji želite da se vidi.

Kako dodati llms.txt u WordPress pomoću plugina

Najbrži i najpraktičniji način da dodate llms.txt u WordPress je uz pomoć plugina All in One SEO (AIOSEO). Ovaj popularni SEO alat automatski generiše llms.txt fajl, vodi računa o njegovom sadržaju i automatski ga ažurira kad god objavite novi tekst ili stranicu.

Nakon što instalirate i aktivirate AIOSEO, ne morate da podešavate ništa dodatno. Opcija za llms.txt je uključena po podrazumevanim podešavanjima, čak i u besplatnoj verziji.

Ukoliko se do sada niste upoznali sa ovim sjajnim alatom, na našem blogu smo vam pripremili nekoliko detaljnih vodiča za instalaciju i podešavanje:

ALL IN ONE SEO plugin – podešavanja za bolji SEO (1.deo)

ALL IN ONE SEO plugin – podešavanja za bolji SEO (2.deo) – Robots.txt

Kako da blokirate loše botove od pristupa vašem veb-sajtu – All in one SEO plugin (3.deo)

Kako da pravilno podesite Social Meta Data za vaš veb-sajt – All in one SEO plugin (4.deo)

Korak 1: Instalacija i aktivacija AIOSEO plugina

U vašem WordPress admin dashboardu idite na sekciju za instalaciju plugina i potražite All in One SEO. Nakon instalacije i aktivacije, možete pokrenuti čarobnjak za podešavanje (Setup Wizard), koji će vas voditi kroz osnovna podešavanja plugina.

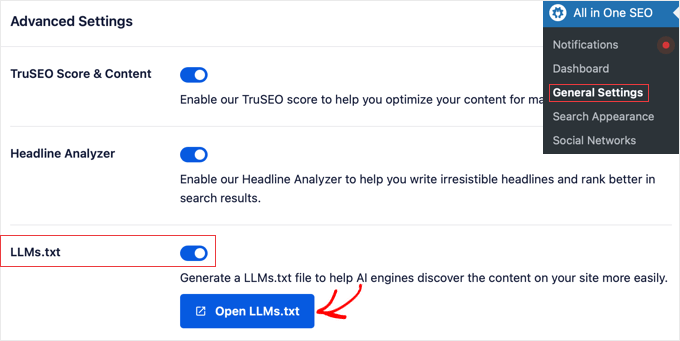

Korak 2: Provera i podešavanje llms.txt fajla

Kada je plugin aktivan, otvorite All in One SEO → General Settings, pa izaberite tab Advanced. Videćete opciju Generate an LLMs.txt file koja je uključena. Klikom na dugme za otvaranje fajla možete pogledati njegov sadržaj. U njemu će biti lista linkova ka ključnim stranicama vašeg sajta.

Na ovaj način ne morate ručno da kreirate ili održavate fajl. AIOSEO automatski daje jasan signal AI crawlerima koji sadržaj na sajtu želite da istaknete.

Kako kreirati llms.txt pomoću online alata

Ukoliko ne želite da koristite plugin, možete napraviti llms.txt pomoću nekog online alata. Proces je jednostavan i sastoji se iz nekoliko koraka.

Napomena: Pre nego što napravite llms.txt fajl, proverite da li neki plugin već ne generiše ovaj fajl umesto vas. Ako, na primer, koristite AIOSEO zbog drugih SEO funkcija, potrebno je da u All in One SEO → General Settings → Advanced sekciji prvo isključite njegovu podrazumevanu opciju za automatsko kreiranje llms.txt fajla. U suprotnom bi vaš ručni fajl i onaj generisan od strane plugina mogli dospeti u konflikt, što može izazvati zabunu kod AI crawlera.

Jedan od najpopularnijih je online alata za kreiranje llms.txt fajla je llmstxtgenerator.org.

Ovaj alat automatski analizira vaš sajt i generiše llms.txt fajl na osnovu njegove strukture i postojećih linkova. Dovoljno je da unesete svoj domen i kliknete na dugme za generisanje. Alat će za nekoliko sekundi kreirati kompletnu strukturu fajla sa linkovima ka ključnim stranicama i sitemap-ovima.

Kada se fajl generiše, jednostavno kliknite na dugme za preuzimanje i sačuvajte ga na svom računaru. Zatim ga prenesite u korenski (root) direktorijum vašeg sajta (najčešće putem FTP-a ili File Manager-a u cPanel-u).

Ako zatim u browseru otvorite na primer adresu https://mojdomen.co.rs/llms.txt, trebalo bi da vidite sadržaj koji je alat generisao.

Ovo je odlična opcija za početnike jer eliminiše svu potrebu za ručnim uređivanjem fajlova. Sve što je potrebno jeste da unesete svoj domen i preuzmete gotovo rešenje.

Napomena: Preporučuje se da sa vremena na vreme (npr. jednom mesečno ili nakon objavljivanja važnih novih stranica) ponovo generišete llms.txt fajl, kako bi u njemu uvek bili ažurirani linkovi ka vašem najvrednijem sadržaju. Na taj način obezbeđujete da AI alati uvek imaju pristup najrelevantnijim stranicama vašeg sajta.

Kako ručno kreirati llms.txt fajl

Ako ne želite da koristite plugin ili online alat, fajl možete napraviti i potpuno ručno. Ova metoda je jednostavna i daje vam potpunu kontrolu nad time koje linkove želite da uključite.

Kao i kod kreiranja pomoću online alata, pre nego što počnete, važno je da proverite da nijedan plugin već ne generiše llms.txt fajl umesto vas. Na primer, ako koristite AIOSEO zbog drugih SEO funkcija, potrebno je da odete u All in One SEO → General Settings → Advanced i isključite podrazumevanu opciju za generisanje llms.txt fajla.

U suprotnom, vaš ručni fajl i onaj koji kreira plugin mogu se sudariti i zbuniti AI crawlere.

Korak 1: Napravite novi tekstualni fajl

Otvorite jednostavan tekstualni editor na računaru — na primer Notepad ako koristite Windows ili TextEdit ako ste na Mac-u.

Kreirajte novi fajl i sačuvajte ga pod tačnim nazivom llms.txt.

Vodite računa da ekstenzija bude .txt, a ne .docx ili nešto drugo.

Korak 2: Dodajte linkove do sadržaja

Zatim u fajl dodajte linkove do stranica i tekstova koje želite da AI alati vide i uzimaju u obzir. Cilj je da napravite jasnu i jednostavnu mapu vašeg sajta koristeći osnovne Markdown naslove i liste.

Najbolja praksa je da uvek dodate link do XML sitemap fajla, jer je to najefikasniji način da AI crawlerima stavite do znanja gde se nalazi kompletan javni sadržaj.

Nakon toga možete kreirati posebne sekcije u kojima ćete istaći najvažnije stranice i tekstove.

Evo jednog primera osnovne strukture koju možete jednostavno prekopirati i prilagoditi svom sajtu:

# Moj web sajt

## Sitemap

- [XML Sitemap](https://mojdomen.co.rs/sitemap.xml)

## Ključne stranice

- [O nama](https://mojdomen.co.rs/o-nama/)

- [Kontakt](https://mojdomen.co.rs/kontakt/)

## Važni tekstovi

- [Vodič za optimizaciju](https://mojdomen.co.rs/vodic-za-optimizaciju/)

- [Ključni članak](https://mojdomen.co.rs/kljucni-clanak/)Kada završite sa unosom linkova, sačuvajte fajl i zatvorite editor.

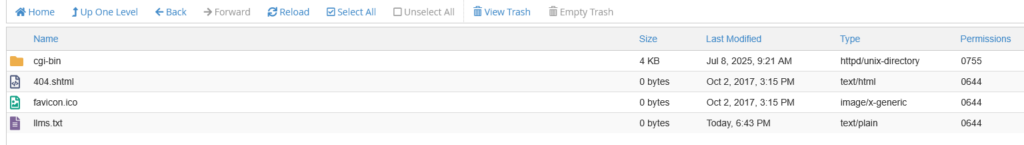

Korak 3: Postavite fajl na server

Poslednji korak je da llms.txt fajl postavite u korenski (root) direktorijum sajta. To je isti folder u kojem se nalazi i robots.txt.

To možete uraditi pomoću FTP klijenta (npr. FileZilla) ili putem File Managera u cPanel-u

Kada otvorite u browseru adresu https://mojdomen.co.rs/llms.txt, trebalo bi da se prikaže sadržaj koji ste upravo kreirali.

Kako blokirati AI botove pomoću robots.txt fajla

Sve što smo do sada napisali ima za cilj da vam pomogne da usmerite AI bot-ove na neki bitan sadržaj na vašem satu. Međutim, možda vi uopšte ne želite da AI alati koriste vaš sadržaj za treniranje modela. U tom slučaju njihovo blokiranje ne radite kroz llms.txt, već kroz robots.txt fajl.

U robots.txt možete dodati pravila za blokiranje određenih crawlera. Na primer, da biste blokirali OpenAI-jev GPTBot, dovoljno je da dodate:

User-agent: GPTBot

Disallow: /Na isti način možete blokirati i Google-Extended, Anthropic-AI ili CCBot. Ako koristite AIOSEO, u okviru sekcije Tools imate jednostavan editor za robots.txt fajl koji smanjuje mogućnost grešaka.

Ako više volite ručni pristup, možete preuzeti robots.txt fajl putem FTP-a, dodati pravila u editoru i vratiti ga na server.

Kako blokirati AI botove pomoću Cloudflare-a

Od nedavno je i Cloudflare uveo opciju da blokirate AI botove direktno na njihovoj platformi, odnosno unutar vašeg Cloudflare dashboard-a. Ukoliko koristite ovaj servis, naša je preporuka da to obavezno uradite. U tu svrhu smo vam pripremili detaljan vodič Kako na Cloudflare-u blokirati AI botove.

Zaključak

Svet AI pretrage i generativne optimizacije menja se veoma brzo. Alati koji danas samo posmatraju sadržaj vašeg sajta, sutra mogu da postanu važan izvor poseta. Zato je važno da već sada razmislite o svojoj strategiji za upravljanje AI botovima.

Ako želite da AI alati ističu vaše najbolje tekstove i stranice, llms.txt je jednostavan način da to i postignete. Ukoliko iz bilo kog razloga želite da neke alate blokirate, robots.txt vam daje mogućnost da to i uradite.

Kombinacijom ova dva pristupa možete aktivno da utičete na to kako AI koristi vaš sadržaj i na taj način preuzmete kontrolu nad onim što želite da vaš sajt ponudi AI botovima.

Nenad Mihajlović